2026 AI 编码工具实战:从 ClaudeCode 到 OpenCode 的极致整合

2026 AI 编码工具实战:从 ClaudeCode 到 OpenCode 的极致整合

在 AI 驱动开发的 2026 年,工具的选择已经不再仅仅是看模型,而是看“工具链的整合能力”和“部署灵活性”。

一、 生产力梯队:谁是真正的王者?

根据长期的实测,我将目前主流的 AI 开发工具分为三个梯队:

- Top 1:ClaudeCode CLI

- 原因:Claude 3.5/4 系列模型的原生推理能力,配合 Anthropic 深度优化的工具链(harness),在代码理解、大规模重构和自主 Agent 任务上处于绝对领先地位。

- 第二梯队:Codex CLI | Copilot CLI

- 特点:依托 GitHub 生态,集成度高,响应速度快,是主流工程开发的稳健选择。

- 第三梯队:OpenCode CLI | Cursor Agent CLI | Gemini CLI

- 特点:灵活性极高,尤其是在特定模型的适配和本地化部署方面有独特优势。

二、 应用场景:本地与远程的黄金搭档

针对不同的开发环境,我的选择策略如下:

- 场景 A:本地开发 (Local)

- 核心工具:Cursor IDE (目前体验最顺滑的 AI 原生 IDE)。

- 备用方案:VSCode + Copilot。

- 场景 B:远程服务端 (Remote/Server)

- 核心工具:ClaudeCode (命令行交互效率极高)。

- 备用方案:Copilot CLI + OpenCode CLI。

三、 OpenCode 的妙用:万能集成器

OpenCode 最强大的地方在于它是一个“中立”的框架,可以与几乎任何 AI 供应商的 API 对接。

1. 实现全平台 API 集成

通过 OpenCode 配合 AI SDK,可以轻松打通以下通道:

- Google Vertex AI: 调用最新的 Gemini Pro Preview 或 Claude 系列。

- AWS Bedrock: 极速访问云端 Claude Sonnet/Opus。

- OpenRouter: 一站式对接各类闭源与开源模型。

- Ollama: 直接调用本地部署的开源大模型。

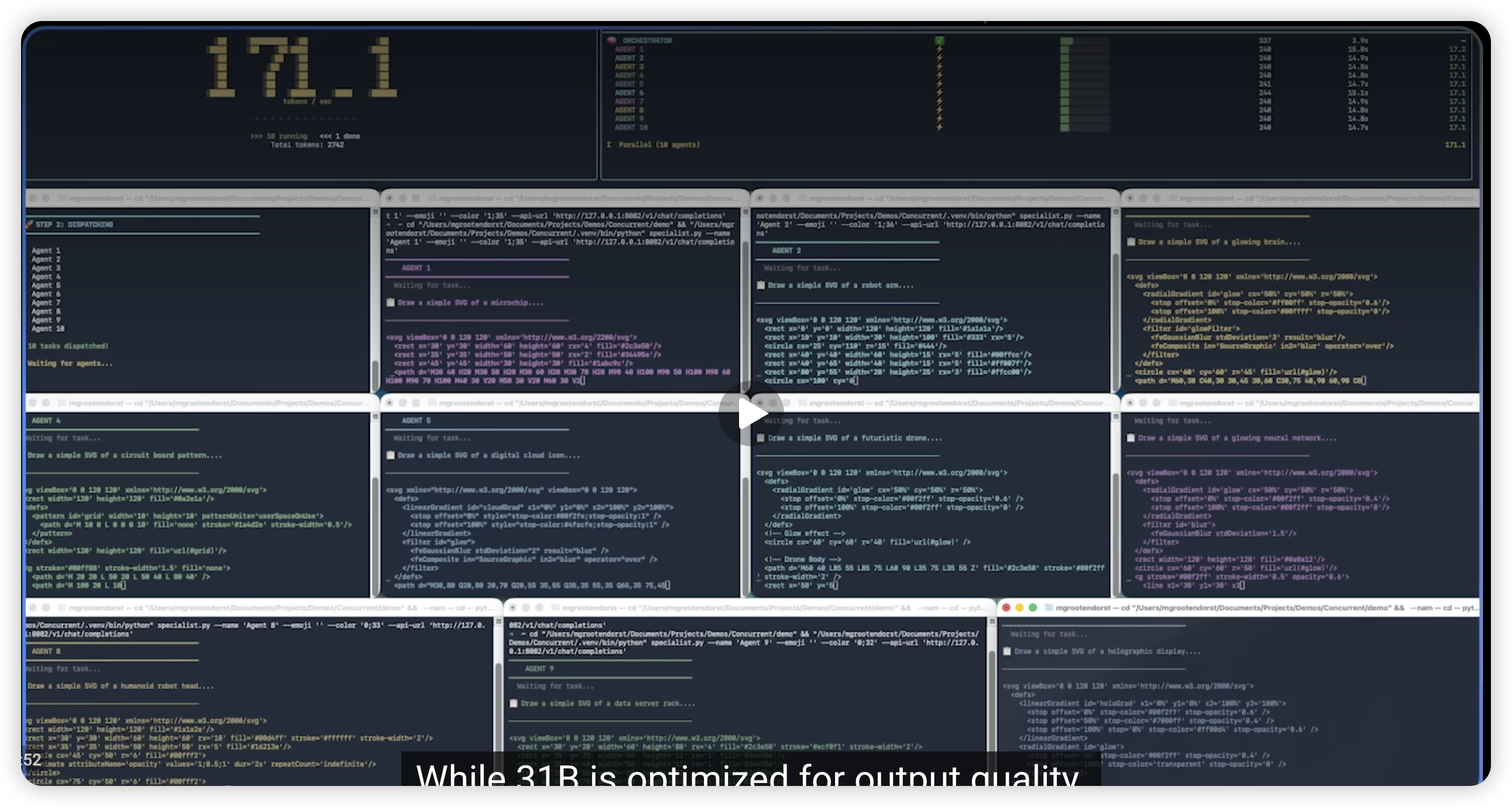

2. 实现“无限 Token”与本地化极速输出

这是 OpenCode 的进阶玩法:通过 OpenCode + Ollama Provider,对接本地或局域网内部署的 Gemma 4 (26b/32b-it)。

在本地硬件支持下,Gemma 4-26b 可以实现惊人的 170 tokens/s 输出速度,彻底解决云端 API 的频率限制和成本问题。

总结

AI 开发工具的选择应遵循“强强联合”的原则:日常开发用 ClaudeCode 追求极致质量,大规模任务或私密项目则利用 OpenCode + 本地 Gemma 实现算力自由。

References

- Anthropic ClaudeCode Documentation

- OpenCode Framework (AI SDK integration)

- Ollama & Google Gemma 4 Research

- Title: 2026 AI 编码工具实战:从 ClaudeCode 到 OpenCode 的极致整合

- Author: Ordiy

- Created at : 2026-04-16 18:50:00

- Updated at : 2026-04-16 10:55:42

- Link: https://ordiy.github.io/posts/2026-04-16-ai-coding-tools-comparison-and-integration/

- License: This work is licensed under CC BY-NC-SA 4.0.

Comments